Zarządzanie ryzykiem HR a zastosowanie sztucznej inteligencji, czyli compliance w firmie

Wszystko co HR musi wiedzieć o zastosowaniu generatywnej sztucznej inteligencji w firmach. Sprawdź, czym jest compliance i jakie są kluczowe kierunki rozwoju AI w kontekście identyfikowania ryzyk i zapobiegania naruszeniom.

- 2 lutego 2024

- 4 min czytania

Zgodność, czyli czym jest compliance w firmach

W procesach biznesowych wielu organizacji coraz częściej wykorzystywane są narzędzia powstałe na bazie generatywnej sztucznej inteligencji. Z punktu widzenia bezpieczeństwa prawnego kluczowe jest, by zastosowanie AI w firmach odbywało się w sposób kontrolowany i świadomy.

Compliance to: zastosowanie się, stosowanie się, podporzadkowanie się.

W środowisku biznesowym, na płaszczyźnie firmy, przedsiębiorstwa, compliance to zbiór przepisów, uregulowań, procedur i rozwiązań zapewniających funkcjonowanie podmiotu zgodnie z przepisami prawa. Wynikać mogę one z kodeksu cywilnego, prawa pracy, prawa podatkowego. Compliance to także identyfikacja ryzyk i przeciwdziałanie nim oraz raportowanie potencjalnych zagrożeń.

Czym zajmuje się specjalista compliance?

Rolą samodzielnego specjalisty lub działu ds. zapewnienia zgodności jest:

- minimalizowanie ryzyka związanego z prowadzeniem działalności firmy

- identyfikacja ryzyk i zapobieganie naruszeniom

- wyeliminowanie i przeciwdziałanie procesom zachodzącym w organizacji, które są niezgodne z obowiązującymi przepisami prawa oraz regulacjami wewnętrznymi – również na płaszczyźnie norm etycznych i społecznych.

Czy sztuczna inteligencja to nowa maszyna parowa?

Z pomocą może przyjść zastosowanie generatywnej sztucznej inteligencji w procesach biznesowych związanych z compliance. De facto, w swojej najprostszej formie, AI funkcjonuje w firmach od wielu lat w postaci np. automatyzacji, wykonywania cyklicznych i powtarzalnych obliczeń/zapytań w systemach informatycznych, czy też w robotach przemysłowych.

Wraz z postępem technologicznym, rozwój AI wszedł na wyższy poziom. Ostatnie miesiące to już kolejne, bardziej zaawansowane rozwiązania w postaci m.in. Chat GPT 3.5 i 4.0, a już mówi się o 4.5 czy nawet 5.0. Dziś AI może m.in:

- poprowadzić rozmowę,

- prowadzić pojazdy,

- tworzyć treści,

- tworzyć melodie,

- tworzyć obrazy,

- diagnozować i wspomagać leczenie (ChatGPD).

AI Act: Nowe ramy prawne dla sztucznej inteligencji w Europie

Korzystanie z narzędzi AI jest dużym wsparciem, ale równocześnie, niesie za sobą ryzyko. Ważne jest, by korzystanie z nowoczesnych technologii odbywało się to w sposób kontrolowany. W Unii Europejskiej trwają prace nad AI Act, który ma ustanowić:

- ramy prawne dla korzystania z AI,

- określić wymogi dla systemów AI,

- wskazać zakazane praktyki dla systemów AI,

- ryzyka i obowiązki spoczywające na operatorach systemów AI.

A jaka w tym rola compliance? To przede wszystkim dostosowanie wewnętrznych procedur obowiązujących w firmie do ryzyka stwarzanego przez określone działania związane z AI. To szukanie punktu równowagi między ograniczaniem ryzyka, a zachęcaniem do innowacyjności i odpowiedzialnego rozwoju. Wśród zalet takiego podejścia wymienia się m. in. możliwość wczesnej interwencji regulacyjnej przy jednoczesnym zachowaniu wymogów dotyczących dostosowania się do korzystania z AI.

Raport EY – jak polskie firmy wdrażają AI

Zgodnie z raportem „Raport EY – jak polskie firmy wdrażają AI” opublikowanym 10 stycznia 2024, wdrożenie AI w Polsce jest na bardzo różnym poziomie. Najczęściej wykorzystywane jest w obszarze obsługi klienta i sprzedaży, odpowiednio 50% i 40%, a w obszarze compliance to zaledwie 6%. W raporcie czytamy, że 93% spośród ankietowanych firm w ciągu najbliższych 18 miesięcy planuje znacznie zwiększyć wydatki na wdrożenie AI związane z usprawnieniem procesów wewnętrznych, czyli w obszarze compilance.

Prawa autorskie, czyli kierunki rozwoju AI w kontekście compliance

Na ten moment brak regulacji prawnych przystających do rzeczywistości. Jedynym aktem prawnym, który (teoretycznie) mógłby stworzyć ramy dla zastosowania generatywnej sztucznej inteligencji jest ustawa z dnia 4 lutego 1994 r. o prawie autorskim i prawach pokrewnych, w obecnym brzmieniu obowiązująca od 6 grudnia 2022 roku. Niestety, nijak ma się ona jednak do możliwości zastosowania sztucznej inteligencji, gdyż rezultat powstały za pomocą sztucznej inteligencji nie stanowi utworu w rozumieniu ustawy.

Przedmiotem prawa autorskiego jest każdy przejaw działalności twórczej o indywidualnym charakterze, ustalony w jakiejkolwiek postaci, niezależnie od wartości, przeznaczenia i sposobu wyrażenia (utwór).

Art. 1 ustawy z dnia 4 lutego 1994 r. o prawie autorskim i prawach pokrewnych

Praca z narzędziami sztucznej inteligencji ma pewne ryzyko. To człowiek ma pomysł, a AI tworzy na podstawie danych wgranych do systemu. Dane te zostały stworzone lub wygenerowane przez inne systemy lub osoby trzecie. Tak powstałe dzieło może naruszać prawa osób trzecich, o czym trzeba pamiętać.

Akademia Inspektora Ochrony Danych

Akademia Inspektora Ochrony Danych  Akademia People & Culture Manager ZW

Akademia People & Culture Manager ZW  Akademia People Business Partner ZW

Akademia People Business Partner ZW  Akademia Zatrudniania Cudzoziemców ZW

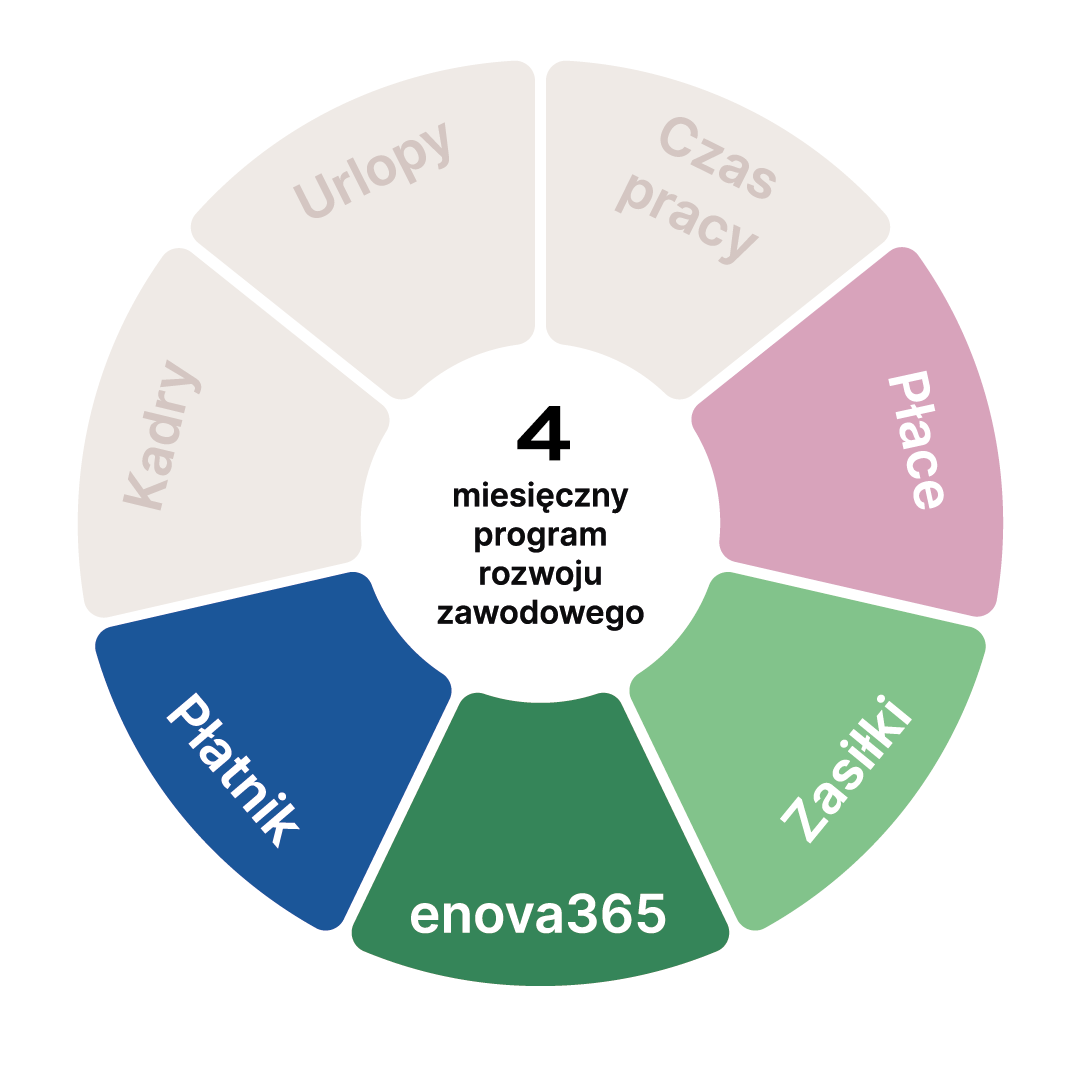

Akademia Zatrudniania Cudzoziemców ZW  Akademia Mistrzostwa Kadrowo-Płacowego ZW

Akademia Mistrzostwa Kadrowo-Płacowego ZW  Akademia Mistrzostwa Kadrowego ZW

Akademia Mistrzostwa Kadrowego ZW  Akademia Profesjonalisty HR ZW

Akademia Profesjonalisty HR ZW  Akademia Mistrzostwa Płacowego ZW

Akademia Mistrzostwa Płacowego ZW  Akademia Master Certyfikowany Kurs Kierownika Działu kadr i płac ZW

Akademia Master Certyfikowany Kurs Kierownika Działu kadr i płac ZW  Akademia Kalkulacji Wynagrodzeń dla wymagających ZW

Akademia Kalkulacji Wynagrodzeń dla wymagających ZW  Akademia Prawa Pracy dla wymagających ZW

Akademia Prawa Pracy dla wymagających ZW  Akademia HR – Certyfikowany kurs specjalisty ds. zarządzania zasobami ludzkimi ZW

Akademia HR – Certyfikowany kurs specjalisty ds. zarządzania zasobami ludzkimi ZW  RODO w HR, kadrach i płacach, ZW

RODO w HR, kadrach i płacach, ZW  EXCEL w HR, kadrach i płacach, ZW

EXCEL w HR, kadrach i płacach, ZW  enova365 w teorii i praktyce, Certyfikowany kurs obsługi programu, ZW

enova365 w teorii i praktyce, Certyfikowany kurs obsługi programu, ZW  PŁATNIK w teorii i praktyce, Certyfikowany kurs obsługi programu, ZW

PŁATNIK w teorii i praktyce, Certyfikowany kurs obsługi programu, ZW  Książka przychodów i rozchodów, Certyfikowany kurs online dla księgowych

Książka przychodów i rozchodów, Certyfikowany kurs online dla księgowych  Certyfikowany kurs Dokumentacja Pracownicza ZW

Certyfikowany kurs Dokumentacja Pracownicza ZW  Warsztaty stacjonarne - Zarządzanie Zespołem Kadrowo-Płacowym

Warsztaty stacjonarne - Zarządzanie Zespołem Kadrowo-Płacowym  Zmiany w prawie pracy 2025

Zmiany w prawie pracy 2025  e-Doręczenia – wdrożenie i obsługa narzędzia

e-Doręczenia – wdrożenie i obsługa narzędzia  Równość i przejrzystość wynagrodzeń: Praktyczny przewodnik po nowej Dyrektywie UE - edycja IV

Równość i przejrzystość wynagrodzeń: Praktyczny przewodnik po nowej Dyrektywie UE - edycja IV  Rozliczanie wynagrodzeń zarządów, rad nadzorczych, menedżerów, edycja II

Rozliczanie wynagrodzeń zarządów, rad nadzorczych, menedżerów, edycja II  Rozliczenia krajowych i zagranicznych podróży służbowych: Przewodnik praktyczny, edycja II

Rozliczenia krajowych i zagranicznych podróży służbowych: Przewodnik praktyczny, edycja II  Eduwersum® Excellence Gift Voucher Edukacyjny

Eduwersum® Excellence Gift Voucher Edukacyjny  Eduwersum® Excellence Pass Voucher Edukacyjny 2000 PLN

Eduwersum® Excellence Pass Voucher Edukacyjny 2000 PLN  Eduwersum® Excellence Pass Voucher Edukacyjny 5000 PLN

Eduwersum® Excellence Pass Voucher Edukacyjny 5000 PLN  Eduwersum® Excellence Pass Voucher Edukacyjny 10000 PLN

Eduwersum® Excellence Pass Voucher Edukacyjny 10000 PLN  Eduwersum® Excellence Pass Voucher Edukacyjny 20000 PLN

Eduwersum® Excellence Pass Voucher Edukacyjny 20000 PLN  Eduwersum® Excellence Pass Voucher Edukacyjny 30000 PLN

Eduwersum® Excellence Pass Voucher Edukacyjny 30000 PLN